Tesla đã quảng cáo rằng Autopilot là hệ thống trợ lái không dễ bị đánh lừa. Thực tế có đúng như vậy khi mới đây khiếm khuyết của hệ thống này được các nhà nghiên cứu Israel phát hiện.

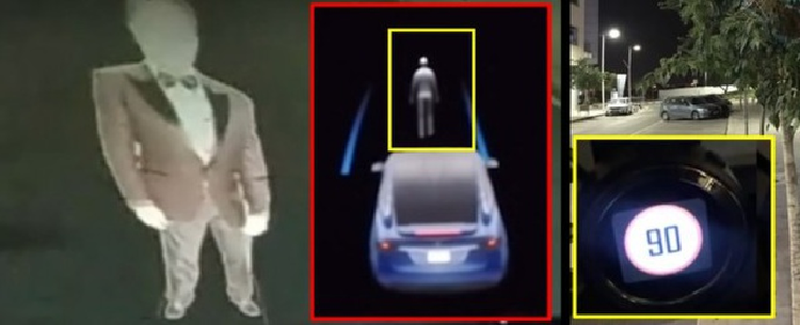

Mới đây, các nhà nghiên cứu Israel đã tìm ra lỗ hổng và điểm cơ bản của hệ thống này bằng cách sử dụng hình ảnh “bóng ma” hoặc ánh sáng được chiếu trong tích tắc nhằm đánh lừa hệ thống lái bán tự động Autopilot của xe Tesla.

Như vậy tức là những chiếc xe điện và xe được trang bị tính năng Tự lái hoàn toàn (FSD) của Tesla có thể gặp rủi ro.

Dù phát hiện ra lỗ hổng trên hệ thống tự lái Autopilot của Tesla. nhưng các nhà khoa học không giới hạn nghiên cứu chỉ ở hãng xe chạy điện lớn nhất thế giới này, mà cho rằng lỗi này có thể đe dọa các phương tiện trang bị FSD hoặc bán tự động Autopilot khác. Các chủ sở hữu xe có hệ thống Autopilot cần hết sức thận trọng và lưu ý vì vẫn rất cần sự chú ý của con người trong quá trình xe lăn bánh.

Những vật thể xuất hiện trong tích tắc mà mắt thường không nhìn thấy được có thể khiến hệ thống hoạt động sai và bị đánh lừa khiến chiếc xe dừng lái. Mặc dù điều này có vẻ nhỏ đối với hầu hết các tài xế tập trung vào tình huống lái xe, tuy nhiên nó cũng có thể gây tử vong với những ai lơ đễnh hay khi xe đang chạy bám sát đuôi xe khác.

Theo trang Wired, nghiên cứu này chủ yếu liên quan tới vấn đề an toàn của Tesla Autopilot, vì đã có một số trường hợp tai nạn chết người liên quan đến tính năng này. Các phát hiện trong nghiên cứu cũng có thể được sử dụng để chống lại các tài xế và phương tiện của Tesla.

Nghiên cứu nhằm mục đích xác định những gì hệ thống Autopilot của Tesla có thể nhìn thấy và cảm nhận được bằng cách sử dụng nhiều camera bao quanh thân xe. Thông tin này hoàn toàn trái ngược với tính năng của Autopilot nhằm mục đích “nhìn thấy” các điểm mù và các yếu tố mà con người có thể sẽ nhận thức chậm.

Đồng sáng lập và CEO Elon Musk của Tesla thừa nhận những khiếm khuyết và nâng cấp từ chính những điểm chưa hoàn thiện đó.

Nhóm các nhà nghiên cứu từ trường Đại học Ben Gurion (Israel) đã bắt đầu công trình nghiên cứu này từ năm 2018, với bài báo đã xuất bản có tiêu đề “Bóng ma của ADAS”. ADAS (Hệ thống hỗ trợ lái xe tiên tiến) là thứ mà nhóm gọi là hệ thống lái tự động xuất hiện trên công nghệ của một số nhà sản xuất xe.

Các nhà nghiên cứu đã “qua mặt” Autopilot chỉ với một phương pháp đơn giản là chiếu các ánh sáng trong tích tắc trực tiếp lên hệ thống camera của xe.

Trong bối cảnh các thực thể độc hại khác nhau hiện diện trong xã hội, các hệ thống hack công khai ngày càng trở nên rõ ràng hơn ngay cả trong thế giới trực tuyến; các tin tặc không ngừng gây ra những sự hỗn loạn trong xã hội. Các nhà nghiên cứu cho rằng sẽ không lâu nữa, các tin tặc sẽ lợi dụng những sai sót của Tesla.

Nghiên cứu cũng cho thấy việc hiển thị các hình ảnh có sự thao túng liên quan tới biển báo dành cho người đi bộ và biển chỉ đường cao tốc cũng có thể đánh lừa hệ thống và camera của ô tô. Điều này gây nguy hiểm cho người lái và các hành khách, cũng như các xe khác đang lưu thông trên đường. Hình thức hack này có thể không để lại nhiều bằng chứng và rất khó theo dõi.

Với việc “lỗ hổng” trong tính năng FSD của Tesla và các hệ thống lái xe tự động của các dòng xe khác được tiết lộ, các chuyên gia khuyến cáo những người sở hữu xe có trang bị ADAS nên quan sát thận trọng và luôn tập trung khi lái xe trên đường.

.png)

.jpg)